AIで画像を生成してみたら、なんだか偏った結果になった…そんな経験はありませんか?

たとえば「CEO」と入力したら男性ばかりが生成されたり、「日本人の家庭」と指定したのに畳や着物ばかりが登場したり。じつは、AIにもこういった偏ったバイアスが存在しています。

前回の記事でハルシネーションについて解説しましたが、今回はもう一つの重要なテーマ、AIが生成する表現に潜む「偏り」について掘り下げてみたいと思います。

デザイナーとして、AIとどう向き合えばインクルーシブな表現ができるのか。一緒に考えていきましょう!

なぜAIにバイアスが生じるのか

まず、AIに偏りが生まれる要因と仕組みを整理してみます。

【要因①】学習データの偏り

AIは、インターネット上の膨大なデータを学習しています。でも、そのデータ自体がすでに偏っているんですよね。

たとえば、ストックフォトやWeb上の画像は、特定の地域(とくに欧米)や属性に偏りがちです。結果として、AIが「普通」と判断するものも、その偏りを反映してしまいます。

【要因②】統計的な「普通」の増幅

AIは「最も頻出するパターン」を優先する傾向があります。

学習データの中で「こういう人がこの役職に多い」というパターンがあると、AIはそれを「正解」として学習してしまう。その結果、現実にある多様なライフスタイルが「ノイズ」として削ぎ落とされ、ステレオタイプが強化されてしまうのです。

【要因③】アルゴリズムの癖

もう一つ厄介なのが、プロンプトで指定しない限り、AIは「最も一般的だと判断した属性」を勝手に追加してしまうこと。

「人物」とだけ指定すると、AIが学習した「最も一般的な人物像」が生成される。これが、知らず知らずのうちにバイアスを再生産してしまう原因になっています。

ビジュアル表現における4つの主要バイアス

では、具体的にどんなバイアスがあるのでしょうか。ビジュアル表現でよく見られる4つのパターンを挙げてみます。

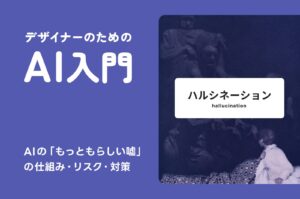

① 職業と役割の固定観念

「CEO」「専門家」と入力すると特定の性別・人種が多く生成され、「清掃員」「サポート役」と入力すると別の属性が多くなる…。こうした役割の固定観念は、AIが学習したデータの偏りをそのまま反映しています。

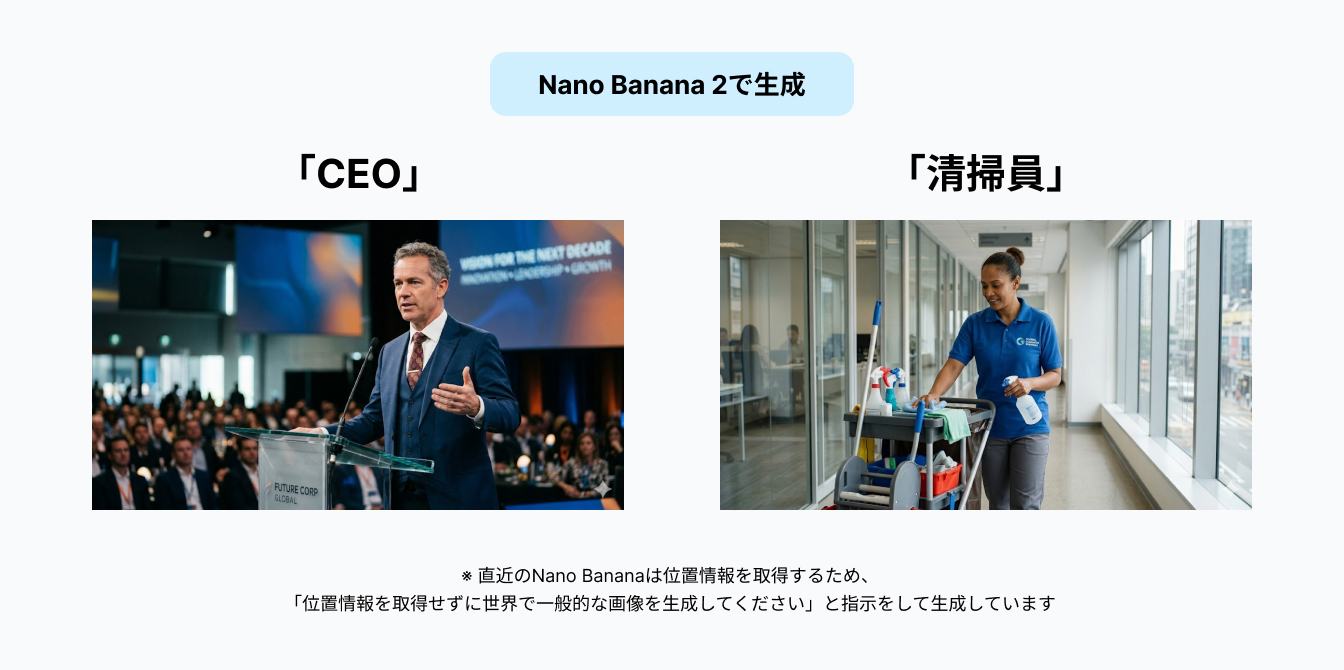

② 文化・地理的な西欧中心主義

「普通の家」「朝食」と入力すると、欧米スタイルの画像が生成されやすい傾向があります。

また、特定の文化を描こうとすると、古いステレオタイプに依存しがちです。たとえば「日本」を指定すると、畳や着物、桜といった「記号」に頼りすぎてしまうことも。現代の日本の暮らしとはかけ離れた表現になってしまうんですよね。

③ 身体的特徴と美の基準

若さ、痩身、左右対称の顔立ちなど、AIは「画一的な美」を出力しがちです。

シニアの方や障がいを持つ方が「日常」から排除されてしまう。これは、学習データにそうした多様な表現が少ないことが原因かもしれません。

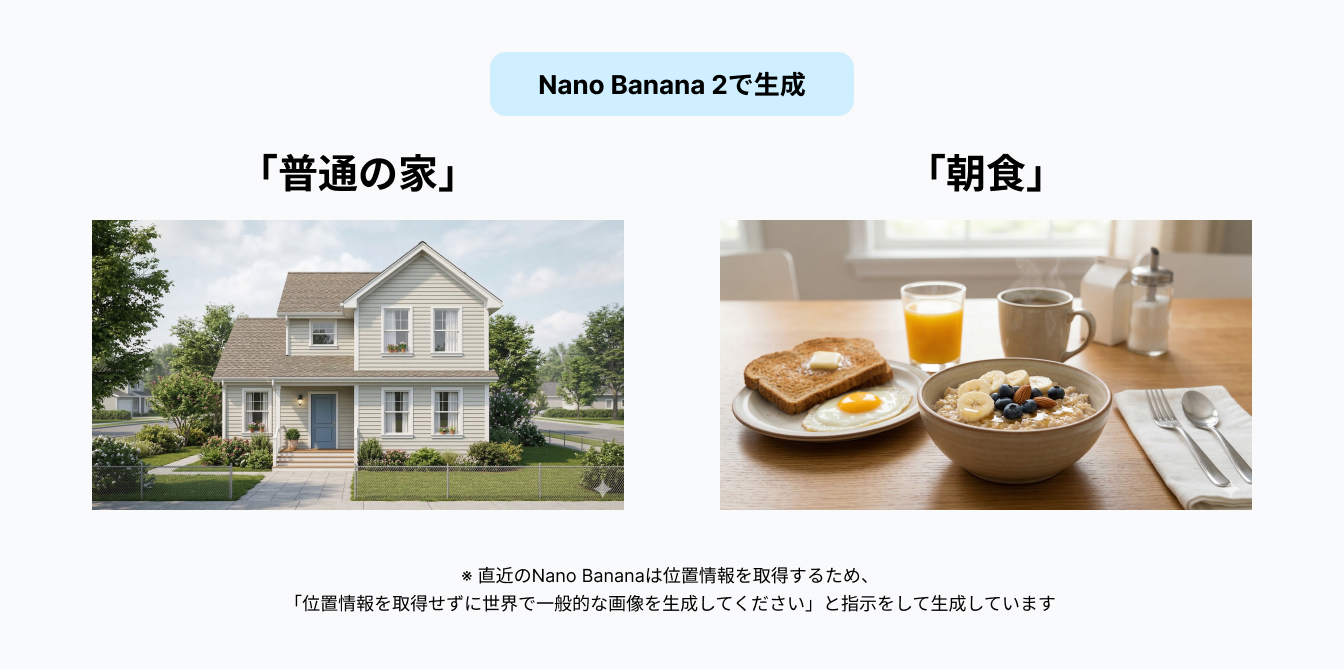

④ 家族像と幸福の定義

「家族」と入力すると、「父・母・子」の核家族がデフォルトとして生成されがち。

ひとり親家庭、単身者、DINKs(共働きで子どものいない夫婦)など、現代の多様な生き方がAIの生成画像には反映されにくいのです。

一方で、上記の画像は、逆に多様性を意識し過ぎている感じもありますね。

このあとに紹介するGeminiのバイアス補正に関係ありそうな結果です。

事例:AIのバイアスに関する問題や話題

AIのバイアスは、すでに現実の問題として表面化しています。最近の事例をいくつかご紹介しますね。

事例1:Bloombergによる画像生成AI調査(2023年)

Bloombergが行った調査では、Stable Diffusionで5,000枚以上の画像を生成して分析した結果、人種や性別による職業格差が現実以上に増幅されていることが判明しました。

たとえば、「CEO」や「弁護士」といった高収入の職業では白人男性の画像が多く生成され、「ファストフード店員」や「清掃員」では別の属性が多くなる傾向が見られたそうです。

AIは現実のステレオタイプを単に再現するだけでなく、それを増幅してしまう可能性があるということですね。

参考:Generative AI Takes Stereotypes and Bias From Bad to Worse – Bloomberg

事例2:Google Geminiの歴史的正確性騒動(2024年)

2024年2月、Googleの生成AI「Gemini」の画像生成機能で大きな騒動がありました。

Geminiは、学習データのバイアスを補正しようとする調整が行われていたのですが、その結果、歴史上の人物まで無理に多様化させてしまったのです。

たとえば「1943年のドイツ兵」というプロンプトに対して、歴史的に不正確な人種構成の画像を生成してしまいました。バイアス修正を試みた結果、逆に文脈を損なってしまった事例といえます。

Googleはこの問題を受けて人物画像の生成機能を一時停止し、調整を行いました。バイアスの補正は、単純に「多様化させればいい」というものではないことがわかりますね。

参考:Google、「Gemini」の人物画像生成の過剰補正問題について説明 – ITmedia NEWS

事例3:Doveの「AI不使用宣言」(2024年)

化粧品ブランドのDoveは、2024年4月に「Real Beauty」キャンペーンの20周年を記念して、重要な宣言を行いました。

「広告において、実在の女性を表現するためにAIを使用しない」という約束です。

Doveの調査によると、女性の3人に1人が「オンラインで見た画像が偽物やAI生成だとわかっていても、自分の外見を変えたいというプレッシャーを感じる」と回答しています。

AIによる「完璧すぎる美」への反発として、Doveは「完璧さより誠実さ(Authenticity Over Perfection)」を重視する姿勢を明確にしました。これは2026年のデザイントレンドとも共鳴する考え方ではないでしょうか。

さらにDoveは、AIを使う人向けに「Real Beauty Prompt Playbook」というガイドラインも公開しています。AIを使うこと自体を否定するのではなく、よりインクルーシブな表現のための指針を示しているのが印象的です。

参考:Keep Beauty Real Campaign | Dove

実践:AIのバイアス発見チェックリスト

ここまでの内容を踏まえて、デザイナーがAI生成画像を確認する際のセルフチェック項目をまとめてみました。

「記号」に頼りすぎていないか?

日本らしさを出すために、現代では珍しい「いただきますの合掌」や「畳」を無理に配置していないか。その文化を知っている人が見たときに、違和感を覚えないか確認してみてください。

役割と力関係はフラットか?

誰かが誰かに仕える、あるいは教えるといった構図に、無意識の属性バイアスが含まれていないか。たとえば「専門家」が常に特定の属性で表現されていないか、チェックしてみましょう。

「現代のリアル」が反映されているか?

ひとりで食事をする人、友人同士の食卓、多様な家族構成…。ターゲットユーザーの「実際の暮らし」が反映されているか考えてみてください。

排除されている人はいないか?

身体的特徴、年齢、家族構成において、ターゲットとするユーザーを「部外者」にしていないか。サービスを使ってほしい人が、ビジュアルから自分を排除されているように感じないか確認しましょう。

これらのチェックポイントは、AIを使うかどうかに関わらず、デザイナーとして大切にしたい視点かもしれませんね。

デザイナーの役割:AIの「ディレクター」として

AIに「正解」を求めてはいけない

AIが出力するのは、あくまで「統計的に最も一般的だと判断された回答」。それが必ずしも「正解」ではないのです。

デザイナーの仕事は、AIが出した「平均的な回答」に対して、リサーチに基づいた「個別のリアル」を指示し直すこと。AIを使いこなす技術以上に、社会の多様性に対する深い理解と「クリティカルな目」が求められているのではないでしょうか。

AIは道具、決めるのは人間

前回の記事でも触れましたが、AIはあくまで「道具」です。最終的な判断をするのは私たち人間。

AIが生成した画像をそのまま使うのではなく、「本当にこれでターゲットユーザーに届くか?」「誰かを傷つけていないか?」と問い直すプロセスこそが、これからのデザイナーの価値になるのだと思います。

2026年のデザイナーに求められること

2026年のデザイントレンドでは、AI技術が進化する一方で、「人間らしさ」「手触り感」「不完全さの美しさ」を重視する傾向が強まっています。Canvaが2025年12月に公開したレポートでは、これを「デザインされた不完全(Imperfect by Design)」と呼んでいるそうです。

AIによる「完璧な」出力に対して、あえて人間らしい揺らぎや個性を取り戻す動き。これは、バイアスの問題とも深くつながっているように感じます。

AIが「平均」を出力するなら、私たちデザイナーは「個別のリアル」を届ける。そんな役割分担ができるのかもしれませんね。

まとめ:AIという鏡を、どう使うかはデザイナー次第

今回の記事のポイントをまとめると、こうなります。

- AIのバイアスの原因:学習データの偏り、統計的な「普通」の増幅、アルゴリズムの癖

- 主要なバイアス:職業・役割の固定観念、西欧中心主義、画一的な美の基準、家族像の固定化

- デザイナーの役割:AIの「ディレクター」として、バイアスをチェックし、個別のリアルを指示する

AIは、インターネット上の膨大なデータの「平均値」を映し出す鏡です。だからこそ、その鏡をどう使い、何を映し出すかは、私たちデザイナーの手に委ねられています。

繰り返しになりまずが、AIが「平均」を出力するなら、デザイナーは「個別のリアル」を届ける。バイアスに気づき、問い直し、方向を指示する。そのプロセスこそが、これからのデザイナーの価値になっていくのかもしれません。

私もまだまだ勉強中ですが、少しでも参考になれば嬉しいです!